출처 : Human-in-the-Loop Strategy for Agentic AI | by Debmalya Biswas | Aug, 2025 | AI Advances

Human-in-the-Loop Strategy for Agentic AI

Collaborative Human-assisted Execution Model for AI Agents

ai.gopubby.com

Langgraph에서 human-in-the-loop 구조를 활용해서 사용자가 에이전트가 특정 액션을 수행하기 전에 다시 한번 그 과정에 대한 컨펌을 줌으로써 안정성을 보장하는 구조를 설계한 바가 있다. 이에 대한 article이 있어 더 살펴보고자 한다.

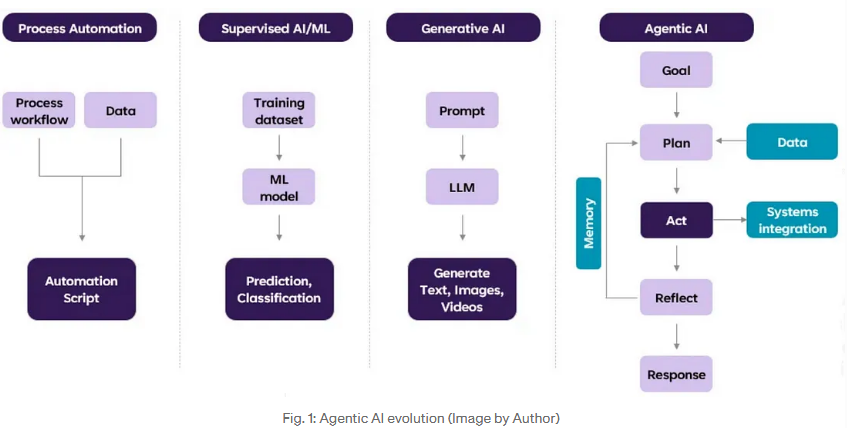

이 사진은 agentic AI 시스템이 어떻게 진화해왔는지를 보여주고 있다.

처음에는 시스템적으로, 즉 일반 함수들로 프로세스가 흘러가도록 다 코딩을 해주는 형태였다가

학습 데이터를 통해 ML 모델을 만들어 예측과 분류를 하는 시스템이 등장하였다.

그 후에는 우리가 지금 익숙하게 사용하고 있는 LLM 모델이 나와 prompt를 통해 원하는 텍스트, 이미지, 영상 등을 생성할 수 있게 되었고, 이제는 특정 태스크를 수행하기 위해 LLM이 행동들을 계획하고 이를 수행하기 위한 각종 툴들을 연계적으로 활용하고 또 이걸 다시 reflect함으로써 완성도가 있는 답변을 생성할 수 있게 되었다.

하지만 여전히 믿을만한 자동화 시스템을 기대하기는 어려운 상태다.

현재의 LLM / 추론 모델은 신뢰성이 부족하기 때문에, 자율 에이전트가 관련 규제 정책과 통제를 충족하면서 안정적으로 작동하도록 보장하는 데 필요한 가드레일을 구축하기가 어렵다.

이와 관련해 Human-in-the-loop 개입 전략이 유망한 대안으로 주목받고 있다.

연구 결과에 따르면 인간이 보조하는 협력적 모델이 과제 수행 측면에서 훨씬 더 효과적임이 입증되었다.

또한, 이러한 방식은 오늘날의 자율 에이전트가 법적,컴프라이언스 요구사항을 충족할 수 있도록 필요한 인간의 감독 역할을 수행하는 데 중요한 역할을 한다.

이를 위해, 우리는 인간을 단순히 감독자,검토자가 아니라 에이전트 생애주기(agentic lifecycle)의 일급 시민으로 통합할 수 있다. 무슨 말이냐면 앞으로는 인간을 시스템의 핵심 구성요소로 두겠다는 뜻이다. 즉, 에이전트가 어떤 일을 계획,실행,검증하는 과정 전반에 처음부터 인간이 참여하도록 구조를 바꾸자는 이야기다.

📌 Agentic AI Lifecycle Management

🔹 Use-Case 사용사례 정의

먼저 사용사례(use-case)를 명확히 정의해야 한다.

▪️ 문제 정의 problem statement

▪️ 비즈니스 맥락 이해 Business context

▪️ 데이터 요구사항 및 가용성 Data Requirements & Availability

▪️ 명확한 목표 설정 및 ROI(투자 대비 효과) 정량화

즉, 에이전트 AI 솔루션이 실제로 무엇을 해결해야 하며, 기업적 가치가 있는지를 처음부터 확실히 해야 한다.

🔹 Marketplace 에이전트/모델/도구 마켓플레이스

단순히 에이전트를 정의하고 도구를 즉석에서 붙이는 방식은 실무에서는 잘 작동하지 않는다.

따라서 에이전트, LLM, 추론 모델, 도구의 마켓플레이스가 필요하다

예시 1) Agent2Agent (A2A) 프로토콜

▪️ Agent Card(JSON) : 에이전트의 디지털 명함

▫️ Identity : 이름, 설명, 제공자 정보

▫️ Service Endpoint : 접속 가능한 url

▫️ Capabilities : 지원 기능(스트리밍, 알림 등)

▫️ Authentication : 인증 방식 (Bearer, OAuth2 등)

▫️ Skills : 수행 가능한 작업 목록 (id, name, input/output 모드, 예시 포함)

클라이언트 에이전트는 Agent Card를 파싱하여 원격 에이전트의 적합성, 요청 구조, 보안 통신 방법을 판단한다.

예시2) Mdoel Context Protocol (MCP)

url을 통해 도구 메타데이터(기능, 요구사항, 상호작용 방식)를 동적으로 검색, 활용 가능

하지만 A2A, MCP 모두 텍스트/자연어 기반 기술 설명에 의존하기에, 경우에 따라 형식적 검색 모델이 필요하다.

🔹 Logic 에이전트 로직 설계

에이전트 로직(목표 달성 계획)은 결정론적(deterministic) 에이전트와 자율적(Autunomous) 에이전트에 따라 달라진다.

▪️ 결정론적 에이전트 : 시작 단계에서 고정된 오케스트레이션 스키마를 정의하고, 미리 정해진 에이전트,도구만 사용

▪️ 자율적 에이전트 : 단순히 목표만 프롬프트로 제시 → 플래너가 동적으로 실행 계획을 수립, 환경/메모리 상태에 따라 계획을 수정

즉, 결정론적은 미리 짠 각본대로, 자율적은 상황을 보면서 즉흥적으로 대응하는 차이다.

🔹 Inference 추론 및 배포 최적화

대규모 LLM을 직접 운영하는 대신 최적화/경량화(SLM)가 과거에는 중요했으나,

최근 기업용 워크플로우 중심에서는 다소 뒷전이 되었다.

그러나 비용 최적화와 전력 효율성은 에이전트가 본격적으로 프로덕션에 도입되면 반드시 다시 주요 이슈가 될 것이다.

따라서 지금 단계에서부터 엣지 디바이스 배포까지 고려한 추론 최적화 전략을 세우는 것이 필요하다

(세부 내용은 'Agentic AI Inference Sizing' 글 참고)

🔹 Governance 거버넌스/통제 체계

마지막은 거버넌스 레이어다.

거버넌스 없이는 어떤 기업도 에이전트를 프로덕션에 배포할 수 없다.

가드레일(Guardrails)은 이미 에이전트 AI의 핵심 요소가 되었다.

엔드투엔드 observability(관측성) - 에이전트가 멈췄을 때 복구, 엉뚱하게 동작할 때 롤백할 전략 필요

에이전트를 신뢰할 수 있는 수준으로 프로덕션에 도입하려면 단순히 코드 몇 줄 작성하는 것을 넘어, 사용사례 정의 → 마켓플레이스 → 로직 설계 → 추론 최적화 → 거버넌스까지 풀스택 엔터프라이즈 레벨 체계가 필요하다.

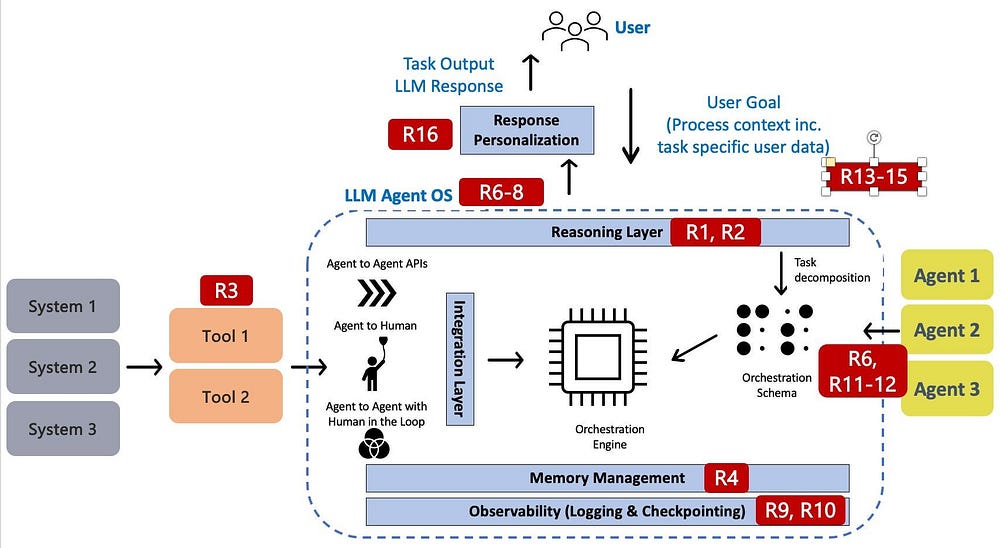

📌 Agentic AI Reference Architecture 참조 아키텍처

▪️ Agents (and tools) marketplace

▪️ Planner - reasoning layer

▪️ Personalization layer

▪️ Orchestration layer

▪️ Observability layer (with logging, checkpoints)

▪️ Integration Layer (integrating with enterprise systems)

▪️ Shared memory layer (long, short tem memory)

🔻 LLM 기반 태스크 분해 (Task Decomposition)

사용자 태스크가 주어지면, 우선 LLM을 활용해 태스크 분해를 수행한다. 이 부분이 생성형 AI와 맞닿아 있는 지점이다.

하지만 동시에, 오늘날의 에이전트형(Agentic) AI 시스템은 결국 LLM의 추론 능력에 의해 제한된다는 의미이기도 하다.

예시 프롬프트가 다음과 같다고 해보자 :

"1개월 안에 매출 100만 달러 달성을 위한 맞춤형 이메일 캠페인을 생성하라. 관련 제품과 성과 지표는 [url]에 있으며, 고객 이름·이메일·인구통계 데이터는 CRM 시스템 [integration]에 있다."

GPT-4가 이 요청을 분해한 결과는 다음과 같다

1. 제품 분석

2. 타겟 고객 식별

3. 맞춤형 이메일 컴페인 생성

이후 LLM은 실행 과정을 계속 모니터링하고, 필요하다면 자율적으로 조정한다.

예를 들어, 목표한 매출을 달성하기 어렵다고 판단했을 때, 에이전트는 스스로 다음과 같은 새로운 작업을 추가하기도 한다:

- 대체 제품 탐색

- 고객 데이터를 활용한 이메일 개인화

- A/B 테스트 수행

이러한 흐름은 곧 개인화(personalization) 계층의 필요성을 보여준다.

LLM은 특정 도메인에 맞춰 파인튜닝(fine-tuning)하는 것과 비슷한 개념이다.

즉, 일반적인 AI 에이전트를 기업 맥락(사용자 페르소나와 실제 사용 사례)에 맞게 커스터마이징하고 파인튜닝해야 기업 내에서 제대로 활용될 수 있다는 것이다.

아래 그림은 사용자 페르소나 기반으로 AI 에이전트를 파인튜닝하는 참조 아키텍처를 보여준다.

이 주제는 다음 포스트에서 더 자세히 다루고 있다고 한다 : https://ai.gopubby.com/personalized-ux-for-agentic-ai-ab132f2eeb03

Personalizing UX for Agentic AI

Fine-tuning AI Agents based on User personas for Enterprise Use-cases

ai.gopubby.com

🔻 에이전트 오케스트레이션 & 통합 (Orchestration & Integration)

여러 개의 에이전트를 동시에 활용하려면 다양한 상호작용 패턴을 지원하는 통합 레이어가 필요하다.

🔹 주요 상호작용 패턴 예시

▫️ Agent-to-Agent API : 에이전트 간 직접 호출

▫️ Agent API → Human Output : 사람이 활용할 수 있는 출력 제공

▫️ Human-tirggered Agent : 사람이 직접 에이전트를 실행

▫️ Agent-to-Agent with Human-in-the-Loop : 에이전트 간 상호작용에 사람이 개입

이러한 패턴을 지원하기 위해서는 AgentOps 플랫폼의 아키텍처가 필수적이다.

또한, 대부분의 실제 비즈니스 활용에서는 엔터프라이즈 시스템과의 연동이 요구된다.

예를 들어 CRM과 같은 기업 시스템과의 데이터 연계가 필요하며, MCP는 이러한 외부 시스템에 연결해 기업 데이터를 동적으로 활용할 수 있도록 해준다.

🔻 에이전트 메모리 관리 (Shared Memory Management)

복잡한 태스크는 보통 장기간 실행된다.

예를 들어, 이메일 캠페인을 실행했다면 한 달 동안 캠페인을 모니터링 해야한다.

🔹 필요한 메모리 기능

▫️ 맥락(Context) 공유 : 개별 작업 간 데이터와 상태를 전달

▫️ 실행 맥락 유지 : 장기 실행에도 전체 흐름을 잃지 않도록 관리

이를 위해 표준적으로는 에이전트 정보를 임베딩으로 변환하여 벡터DB에 저장한다.

▫️ 검색 시 MIPS(Maximum Inner Product Search) 방식을 활용

▫️ 빠른 검색을 위해 ANN(Approximate Nearest Neighbors) 알고리즘 적용 → 정확도를 조금 희생하지만 큰 속도 향상을 얻을 수 있음

위 그림은 이러한 에이전트 AI 시스템의 메모리 관리 구조를 보여주며, 단기 메모리와 장기 메모리 모듈을 모두 포함한다.

자세한 내용 : https://ai.gopubby.com/long-term-memory-for-agentic-ai-systems-4ae9b37c6c0f

Long-term Memory for AI Agents

Why Vector Databases are not sufficient for Memory Management of Agentic AI Systems?

ai.gopubby.com

📌 Agentic AI Risk Management

에이전트형 AI (Agentic AI)가 실제 프로덕션 환경에 점점 더 많이 배치되면서, 그 리스크 관리에 대한 관심이 커지고 있다.

여기서는 새로운 리스트를 만드는 대신, 아래 문서에서 제시된 리스크를 토앟밯여 정리한다.

▪️ OWASP 백서 : Agentic AI - Threats and Mitigations, 2025

▪️ IBM 백서 : Accountability and Risk Matter in Agentic AI, 2025

R1~15는 [OWASP]에서 정의한 리스크이고, 괄호() 안의 내용은 [IBM]에서 제시한 대응 개념이다.

R16은 [IBM]에는 있지만 [OWASP]에는 없는 Persona-driven Bias(페르소나 기반 편향) 이라는 흥미로운 항목이다.

🔹주요 리스크 항목 정리

📍 Security Vulnerabilities / 보안 취약점

R1 : Misaligned & Deceptive Behaviors (Dynamic Deception) - 잘못 정렬된 /기만적 행동

R2 : Intent Breaking & Goal Manipulation (Goal Misalignment) - 의도 왜곡, 목표 조작

R3 : Tool Misuse (Tool/API Misuse) - 도구/API 오용

R4 : Memory Poisoning (Agent Persistence) - 메모리 오염, 영속성 공격

R5 : Cascading Hallucination Attacks (Cascading System Attacks) - 연쇄 환격 / 시스템 공격

📍 Operational Resilience / 운영 탄력성

R6 : Privilege Compromise - 권한 침해

R7 : Identity Sppofing & Impersonation - ID 위조 및 사칭

R8 : Unexpected RCE & Code Attacks - 원격 코드 실행 및 코드 공격

📍 Multi-agent Collusion / 다중 에이전트 협공

R9 : Resource Overload - 자원 과부하

R10 : Repudiation & Untraceability - 행위 부인 및 추적 불가

R11 : Rogue Agents in Multi-agent Systems - 악의적 에이전트 존재

R12 : Agent Communication Poisoning - 에이전트 간 통신 교란

R13 : Human Attacks on Multi-agent Systems - 사람에 의한 공격

📍 Human Oversight / 인간 개입 리스크

R14 : Human Manipulation - 인간 조작

R15 : Overwhelming Human in the Loop - 인간 의사결정 과부하

R16 : Persona-driven Bias - 페르소나 기반 편향

🔹 리스트 대응 전략

흥미로운 점은, 많은 논의에서 리스크 완화(mitigation)를 중앙 Guardrails Layer에만 맡기는 경우가 많다는 것이다.

그러나 이는 현실적이지 않다.

▪️Guardrails는 특정 유즈케이스에 맞게 설계되어야 하며,

▪️ 개별 플랫폼 구성요소/레이어 단위에서 구현되어야 한다.

이는 곧 전체 솔루션 아키텍처 설계에 직접적인 영향을 미친다.

📌 Human-in-the-Loop Intervention Strategy for AI Agents

에이저트형 AI 라이프사이클에서 사람은 단순 감독자/검토자 (supervisor/reviewer)가 아니라,

핵심적인 주체 (first-class citizen)로 참여해야 한다.

이를 위해서는 적절한 UI/UX 설계가 필요하며, 사용자가 적절한 시점에 적절한 작업에 개입할 수 있어야 한다.

이는 마치 에이전트 상태를 체크포인트 하는 것과 유사하게, 얼마나 자주, 어떤 형식으로 피드백을 받을지가 중요하다.

🔹 인간 개입이 필요한 주요 지점

🔻 Co-plan (공동 계획 수립)

생성된 실행 게획 (오케스트레이션 그래프)이 사용자 의도와 맞는지 검증 및 조율

🔻 Co-execute (공동 실행)

실행 도중 사용자가 일시정지(pause) 후 피드백 제공

에이전트/도구의 응답이 기대와 다르거나 장기 목표 달성이 불가능해 보일 경우 개입

🔻 Co-comply (공동 준수 검증)

결제와 같은 중요, 불가역적 작업에 대해 사용자 승인 절차 필요

기업 정책과 일치하도록 Guardrails 적용 여부 확인

🔻 Co-memorize (공동 메모리 관리)

장기 메모리 개념을 검토 및 개선

저장 최적화, 재사용성 보장, 에이전트 성능 개선 지원

이러한 개입 전략은 단발적인 것이 아니라, 과거 상호작용에서 학습해 향후 개입 과정을 최적화하는 지속적 개선(continuous improvement) 모듈과 결합된다.

즉, 사람과 에이전트가 협력하는 구조를 통해 에이전트는 더 신뢰성 있고 기업 친화적인 방식으로 운영될 수 있다.

📌 Conclusion

현재 자율형 AI 에이전트 (autonomous AI Agent)의 엔터프라이즈 도입은 신뢰성과 안정성의 위기에 직면해 있다.

이를 해결하기 위해, 본 글에서는 인간을 에이전트 라이프사이클의 핵심 주체로 통합하는 프레임워크를 제시하였다.

핵심을 요약하자면,

- 추론 한계 보완 : 현재 LLM이 가진 추론(reasoning)한계를 인간이 협력자로 개입함으로써 보완

- 컴플라이언스 강화 : 인간의 개입을 통해 필수적인 감독(oversight)과 가드레일 확보

- HITL 전략의 가치 : 계획, 개인화, 컴플라이언스 등의 영역에서 에이전트 운영을 체계화하고, 기업 채택을 가속화할 수 있다.

'AI > Articles' 카테고리의 다른 글

| 6 Open-Source AI Projects You Must Try (Agents, RAG & Fine-Tuning) (0) | 2025.09.22 |

|---|---|

| NodeRAG: Installing a “Structured Brain” for LLMs — AI Innovations and Insights 43 (0) | 2025.09.10 |

| Mastering Agentic Workflows with Langraph: A Comprehensive Guide (1) | 2025.08.26 |

| AI 시대의 데이터 전략, '레이크하우스'로 통합하라 (1) | 2025.08.14 |

| AI Agents XII — LangGraph graph-based framework . (3) | 2025.07.24 |